جدة ــ وكالات

حذر المدير العام للجنة الدولية للصليب الأحمر، إيف داكورد، من أن التطور السريع لتقنيات الذكاء الصناعي دفع بالبشر لصناعة روبوتات مستقلة عنها، تقوم باتخاذ قرار الاشتباك والقتل منفردة.

وشدد داكورد على ضرورة فرض دول العالم لقوانين وضوابط صارمة، حول صناعة وتطوير “الروبوتات القاتلة”.

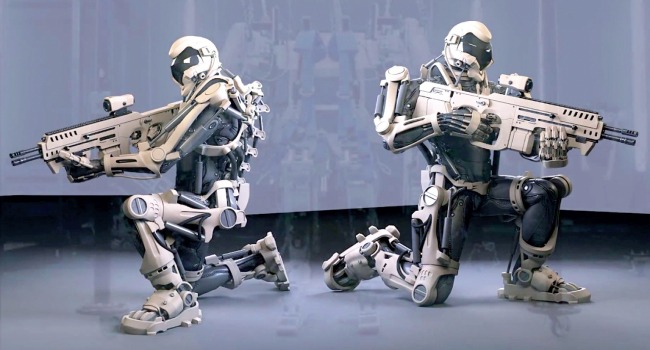

وتشمل “الروبوتات القاتلة” كافة أنواع الأسلحة والمعدات العسكرية الذكية، التي تنجز مهاما قتالية دون الرجوع للإنسان الذي قام بصناعتها وتطويرها.

كما أضاف الموظف الدولي أن تطوير هذه الروبوتات الخطيرة يطرح سؤالا أخلاقيا ملحا، حول تفويض الآلة باتخاذ قرارات حتمية ومصيرية نيابة عن الإنسان.

وأشار داكورد محذرا إلى أن الخطورة الحقيقية تكمن في عدم امتلاك الروبوتات لخواص إنسانية محددة، كالتعاطف مثلا، الخاصة الضرورية للقيام “بقرار أخلاقي معقد”.

وبمعنى آخر، لا تستطيع “الروبوتات القاتلة” محاكمة المواقف المعقدة كما يفعل البشر، وخاصة فيما يتعلق بتحديد حجم الهجوم المضاد، أو التفريق بين المقاتلين والمدنيين في أرض المعركة، كما أنها لا تستطيع الالتزام بمبادئ القانون الدولي الإنساني.